動作認識データセット横断の動作ラベル間関係データセット「MetaVD」を公開しました A meta dataset that annotates relationships between action labels across action recognition datasets, MetaVD, is published

2022.01.23

2022.01.23

動作認識は、コンピュータビジョンにおいて近年盛んに研究されている問題の一つであり、多くのモデルやデータセットが発表されてきました。特にデータセットに関しては、世界中の大学・企業・研究所が各々の目的のために異なるデータセットを構築してきました。STAIR Labでも、家庭やオフィス内で見られる100種類の動作を認識するためのデータセット「STAIR Actions」を構築し、公開しています。

直感的には、多くのデータセットを同時に利用して動作認識モデルを学習することで、精度良く動作が認識可能になると期待できます。つまり、2つのデータセットに共通の動作ラベルがあれば、それを統合することで動画を増やすことができ、その結果として動作認識モデルの性能が上がるという流れです。しかし、これまでの研究では、これはあまり取り組まれてきませんでした。一つの要因は、データセット間で動作ラベルが対応関係がデータとして存在しなかったためだと考えられます。

そこで、我々はデータセット横断で動作ラベルの関係性をアノテーションしたデータセット「MetaVD」を構築しました。MetaVDでは、UCF101、HMDB51、ActivityNet、ActivityNet、STAIR Actions、Charades、Kinetics-700 という、動作認識研究でよく用いられているデータセットについて、全てのデータセットのペアに対して、関係性のアノテーションを行いました。

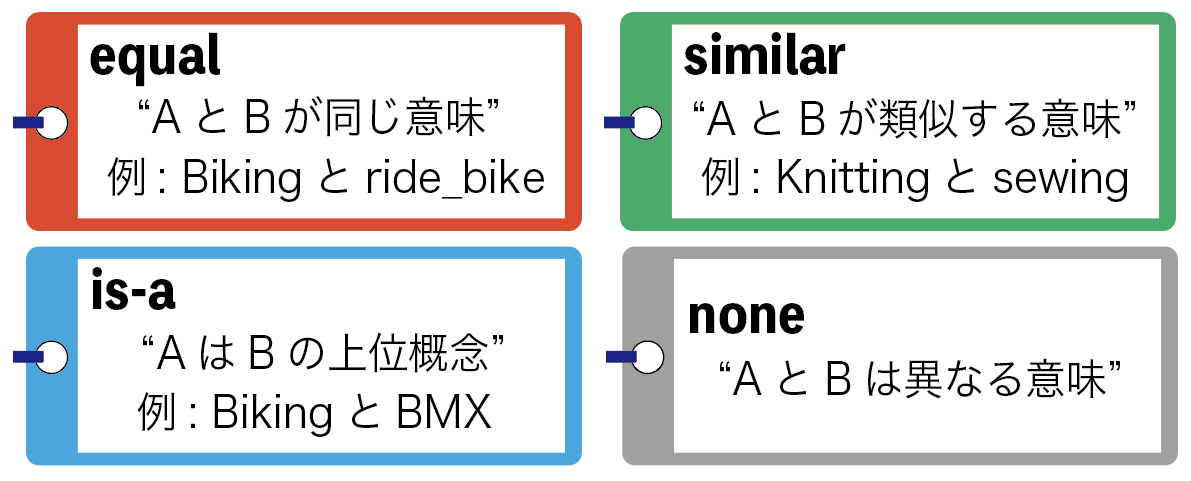

MetaVDでは、動作ラベル間の関係性として、次の4種類を考えます。

例えば、動作ラベルAがUCF101の”Biking”、動作ラベルBがHMDB51の”ride_bike”のときには、その間には”equal”という関係をアノテーションしています。このようにして、”none”も含めると合計568,015件の関係付けアノテーションを行いました。

MetaVDを利用すると、冒頭で述べた、多くのデータセットを同時に利用して動作認識モデルを学習することが可能になります。具体的には、UCF101の動作ラベル”Biking”の動画を増やすために、これとequal関係にあるHMDB51の”ride_bike”や、is-a関係にあるActivityNetの”BMX”の動画を”Biking”というラベルに変えて使うということです。我々の実験では、このようにデータを増やして学習した認識モデルは、単一のデータセットで学習した認識モデルでは間違える動画を正しく認識できるようになる場合があることを確認しました。

MetaVDの提案とMetaVDを用いた場合の動作認識モデルの性能評価の論文は、国際ジャーナルComputer Vision and Image Understanding (CVIU)に掲載されていますので、詳細についてはこちらをご覧ください。

また、MetaVDのアノテーションデータは https://github.com/STAIR-Lab-CIT/metavd で公開中です。CC-BY4.0ライセンスで公開しておりますので、研究や開発でご自由にお使いください。